Крупнейший в мире контрактный производитель электроники Foxconn представил первую крупную языковую модель FoxBrain собственной разработки с возможностью к рассуждениям, процесс обучения которой занял всего четыре недели. Сообщается, что новая модель ИИ основана на архитектуре Meta Llama 3.1 и оптимизирована для традиционного китайского диалекта, используемого на Тайване.

Foxconn сообщила, что Nvidia оказала поддержку в реализации проекта с помощью крупнейшего на Тайване суперкомпьютера Taipei-1 и услуг технического консалтинга в процессе обучения модели. Во время обучения модели Foxconn FoxBrain было задействовано 120 ускорителей Nvidia H100.

Источник изображения: Foxconn

Источник изображения: Foxconn

Спектр возможностей FoxBrain, разработанных для использования в компании, включает анализ данных, математические вычисления, решение проблем, совместную работу с документами, рассуждение и генерацию программного кода.

Модель » отдает приоритет оптимизированным стратегиям обучения, а не простому использованию вычислительной мощности” для решения проблемы, сказал Юнг-Хуэй ли (Yung-Hui li), директор Исследовательского центра ИИ Foxconn.

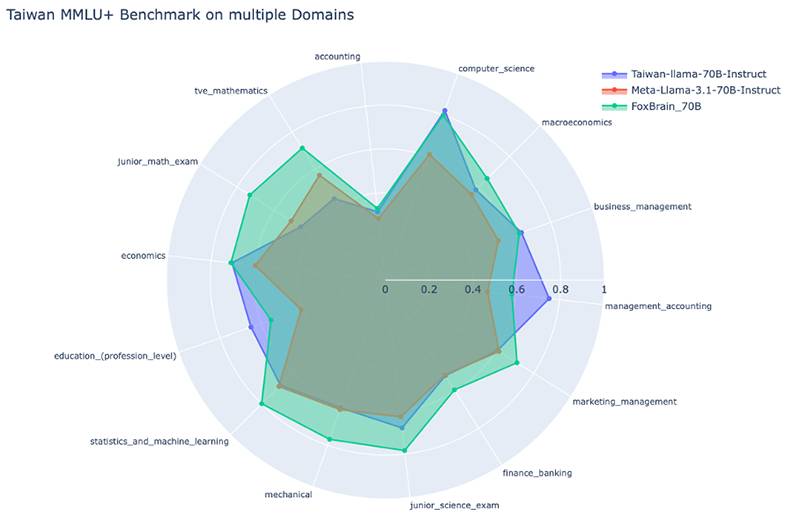

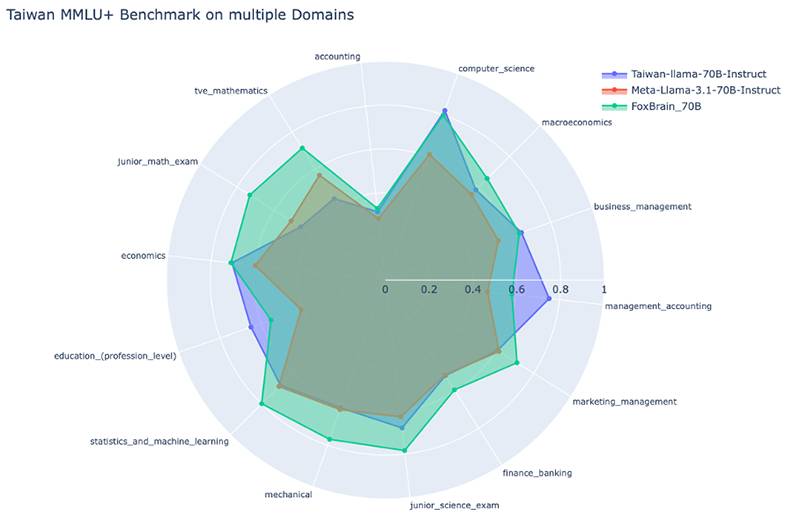

Foxconn отметила, что, хотя FoxBrain немного уступает по производительности китайской модели дистилляции DeepSeek, ее общая производительность близка к мировым стандартам, что позволяет использовать ИИ-модель для улучшения управления производством и цепочкой поставок компании.

В дальнейшем Foxconn планирует открыть исходный код модели, что позволит сотрудничать с технологическими партнерами для расширения областей применения модели, обмена информацией и продвижения ИИ в производстве, управлении цепочками поставок и интеллектуальном принятии решений.

Компания сообщила, что раскроет дополнительные подробности о FoxBrain на конференции разработчиков ИИ Nvidia GTC в середине марта.